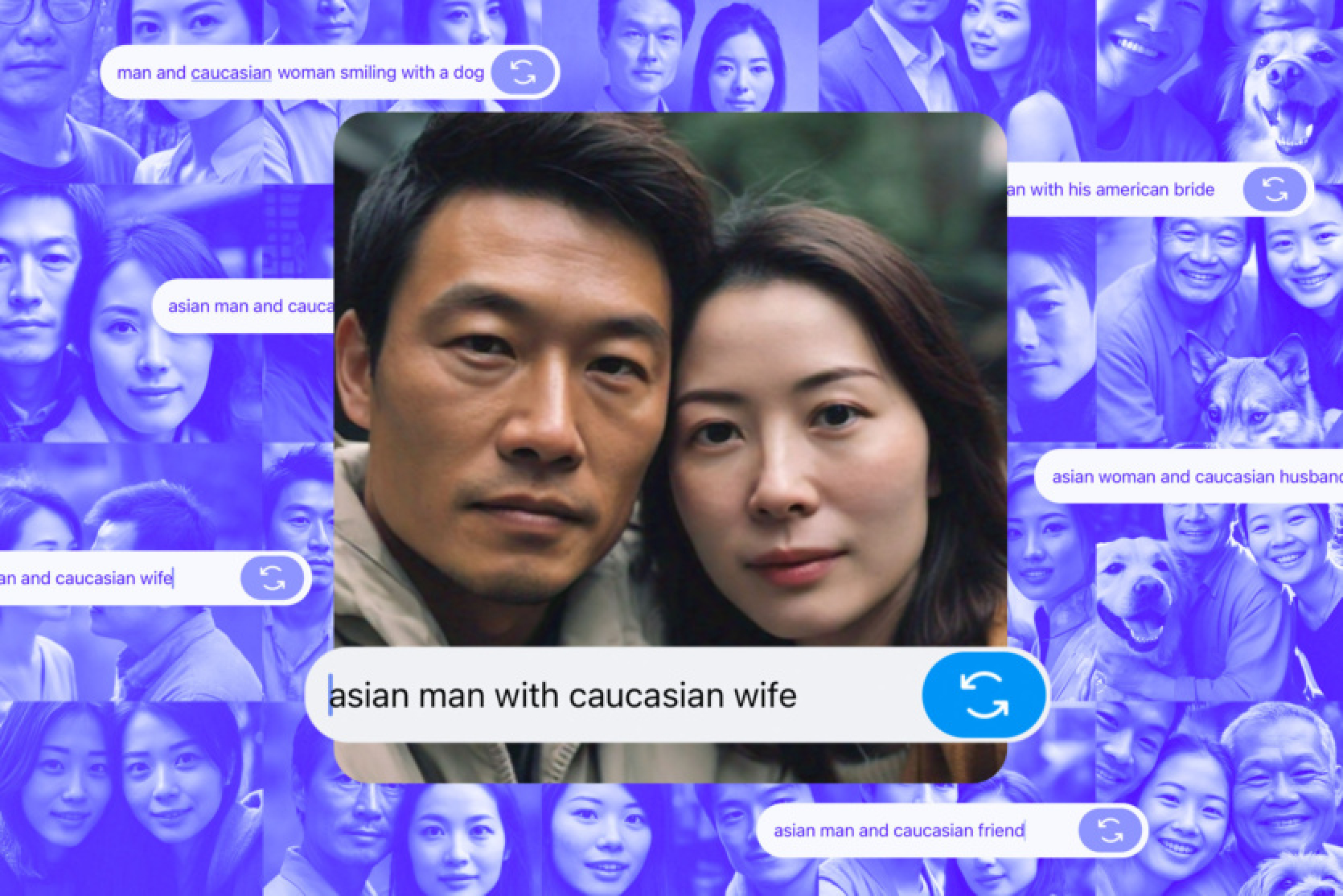

Meta ģeneratīvā mākslīgā inteliģence tendenci radīt attēlus ar cilvēkiem vienas rases, pat ja bija skaidri norādīts pretējais. Piemēram, pieprasot "aziatu un kaukāziešu draugu" vai "aziatu un baltu sievu", attēlu ģenerators radīja attēlus ar cilvēkiem vienas rases.

The Verge žurnālisti atklāja šo problēmu, ko vēlāk apstiprināja Engadget. Veicot attēlu ģeneratora testēšanu Meta, pieprasot "aziatu ar baltu draudzeni" vai "aziatu ar baltu sievu", tika radīti attēli ar āzijas pāriem. Kad tika prasīts par "daudzveidīgu cilvēku grupu", Meta AI rīks radīja režģi ar deviņiem balto cilvēku sejām un vienu cilvēku citas krāsas ādā. Bija gadījumi, kad tas radīja vienu pareizu rezultātu, kas atbilda pieprasījumam, bet lielākoties tas nevarēja precīzi atspoguļot norādīto pieprasījumu.

Saskaņā ar The Verge, Meta AI pastāv arī citi "sīkāki" priekšvēsturiski zīmējumi. Piemēram, ģenerētajos attēlos novērojama tendence attēlot vecākus āzijas vīriešus un jaunākas āzijas sievietes. Attēlu ģenerators dažreiz pievienoja "īpašas kultūras drēbes", pat ja tas nebija daļa no ievadītā teksta.

Nav skaidrs, kāpēc Meta ģeneratīvais AI pretojas tiešiem pieprasījumiem. Uzņēmums pagaidām nav komentējis situāciju, bet agrāk Meta AI tika raksturota kā "beta versija", tāpēc tā varētu darboties ar kļūdām.

Šī nav pirmā ģeneratīvā mākslīgā intelekta modelis, kas dīvainā kārtā radījis cilvēku attēlus. Nesen Google apturēja iespēju radīt cilvēku attēlus ar Gemini pēc dažādas dažādības kļūdām. Vēlāk Google izskaidroja, ka tās iekšējās piesardzības pasākumi neparedzēja situācijas, kad dažādi rezultāti nebija atbilstoši.

Avots: Engadget

Komentāri (0)

Šobrīd nav neviena komentāra