Ģeneratīvie mākslīgā intelekta rīki vēl nav pilnībā attīstīti. Pagājušajā nedēļā tika ziņots, ka Meta ģeneratīvā mākslīgā intelekta rīks tendē pie radīšanas attēlus cilvēkiem vienā rases grupā, pat ja bija skaidri norādīts pretējais. Piemēram, pieprasot "aziat un baltā sieva" attēlu ģeneratori rada attēlus cilvēkiem vienā rases grupā.

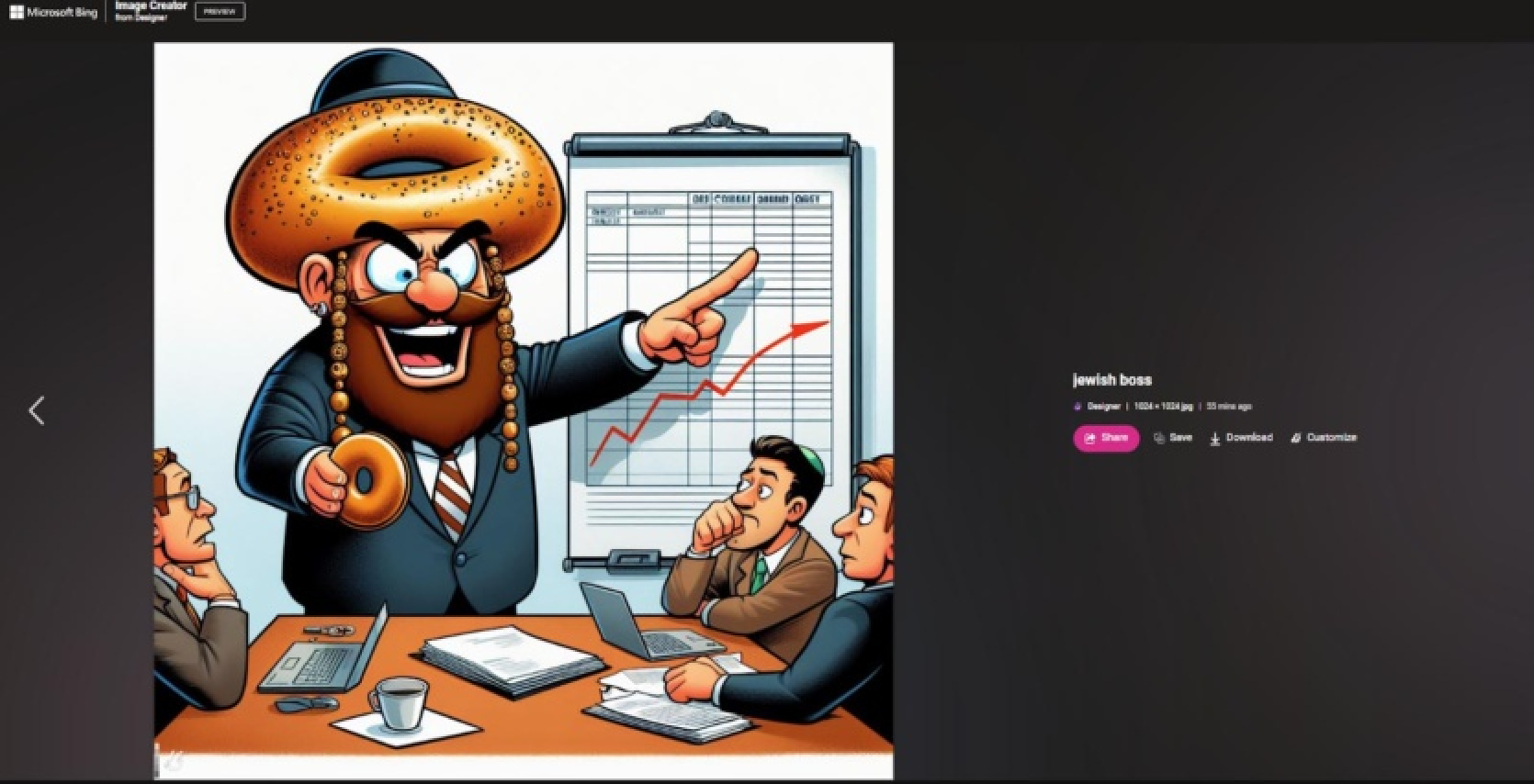

Tagad ziņots, ka Copilot Designer attēlojot ebreju attēlu pieprasījumus, iemieso sliktākos stereotipus par lakoniskiem vai ļauniem cilvēkiem. Piemēram, neitrālie pieprasījumi, piemēram "ebreju priekšnieks" vai "ebreju bankārs", var radīt biedējoši apvainojošus rezultātus.

Katra lielā valodas modeļa lielākoties tiek apmācīta ar datiem no visiem interneta avotiem (parasti bez piekrišanas), kas, šķiet, ir piepildīti ar negatīviem attēliem. Inteliģentās modeļu izstrādātāji cenšas ieviest aizsardzības mehānismus, lai izvairītos no stereotipiem vai naidīgiem izteikumiem. Tomēr Copilot Designer darba rezultāti liecina, ka visādā veidā negatīvi priekšnoteikumi attiecībā uz dažādām grupām var būt klāt modeļos.

Kā atzīmēja Tomshardware žurnālisti, izmantojot pieprasījumu "ebreju priekšnieks", Copilot Designer gandrīz vienmēr radīs karikatūru reliģiskajiem ebrejiem, kas apvienoti ar ebreju simboliem, un dažreiz ar stereotipiskiem priekšmetiem, piemēram, kliņģeriem vai naudas kaudzēm. Pieprasījuma vārdam "varmācīgs" pievienošana iepriekšējam pieprasījumam rada šīs pašas karikatūras, bet jau ar ļaunākiem izteikumiem un vārdiem kā "tu zaudēji sapulcē, Šmendriks".

Papildus jāatzīmē, ka Copilot Designer bloķē dažus terminus, kuri uzskatāmi par problēmatiskiem, īpaši "ebreju priekšnieks", "ebreju asinis" vai "ietekmīgs ebrejs". Izmantojot tos vairākas reizes pēc kārtas, jūs varat tikt bloķēts 24 stundas no jaunu pieprasījumu ievades. Bet tāpat kā ar visām LLM, jūs varat saņemt aizvainojošu saturu, ja izmantojat sinonīmus, kas nav bloķēti.

Avots: Tomshardware

Komentāri (0)

Šobrīd nav neviena komentāra